CES 2025:eYs3D Microelectronics将推多传感器控制器IC、空间感知及导航解决方案

随着AI(人工智能)图像传感和边缘计算技术的迅猛发展,机器人及智能无人驾驶车辆市场也在经历着指数级增长。据外媒报道,钰创科技(Etron Technology)旗下子公司eYs3D Microelectronics推出了一款新型eSP936多传感器图像控制器IC(集成电路)。eSP936可支持多达七个视觉传感器的数据同步处理,图像识别精度高,且结合Sense and React人机交互开发者界面,其可通过人机交互实现智能控制,成为智能应用实施的关键驱动力。

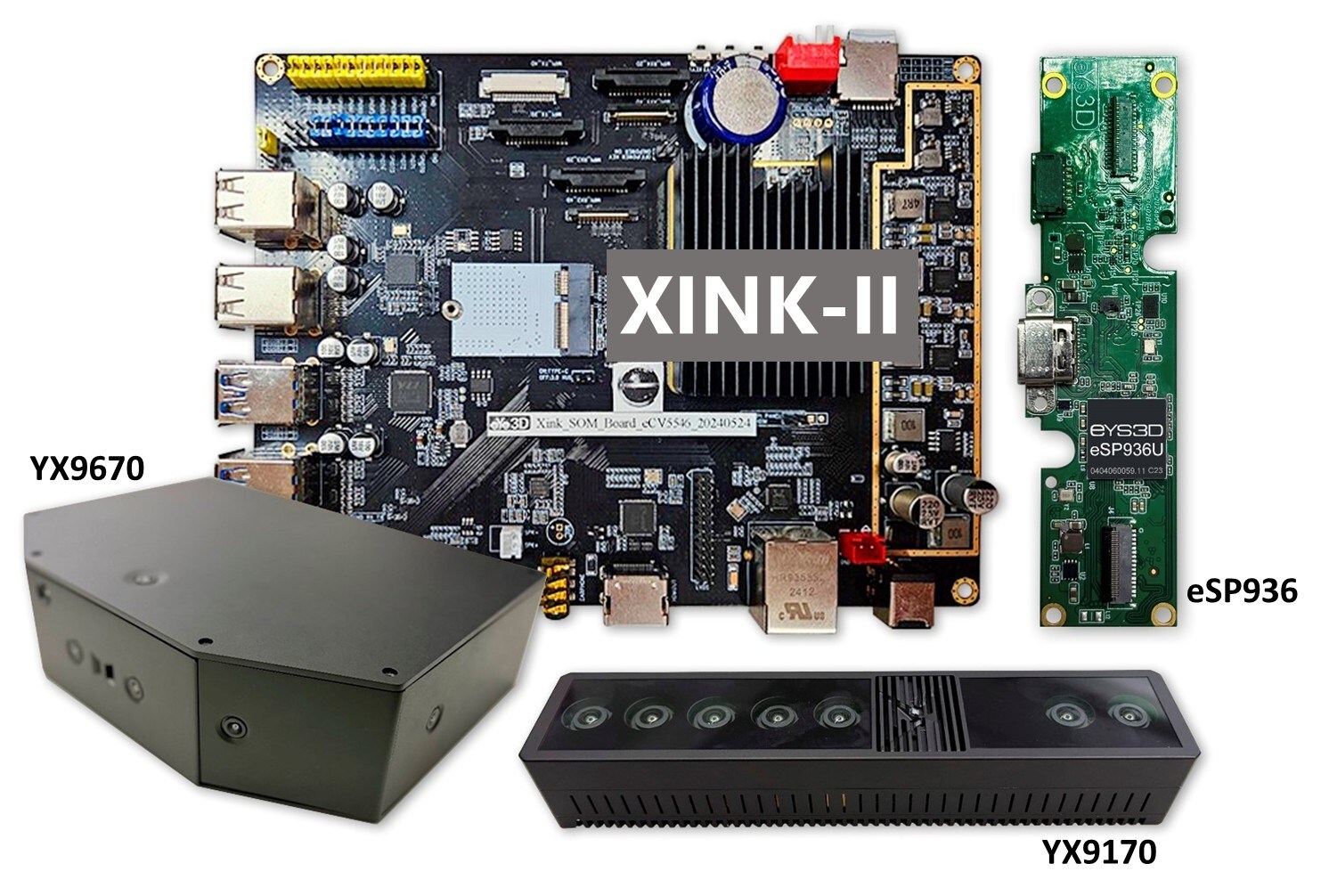

eYs3D Microelectronics在CES 2025推多种解决方案(图片来源:eYs3D Microelectronics)

eSP936可与多模态视觉语言模型(VLM)集成,将多个视觉传感器与实时AI边缘计算能力相结合,适用于无人驾驶车辆(如自动导引车)、自动移动机器人和无人机等无人载具的智能应用场景。此外,eSP936还可高速处理多个2D图像,并生成3D深度地图,从而实现精确的环境感知。嵌入式AI芯片支持复杂环境下的动态导航功能。此外,工业和服务机器人在复杂场景中可以实现更精准的智能感知,结合实时计算和自动化操作,实现高效性能表现。在沉浸式人机交互系统中,eSP936可集成至AI SoC(系统集成芯片)平台,以提升Sense and React交互体验,广泛应用于无人机、无人水面艇(USV,Unmanned Surface Vehicle)、视频会议、增强型教育及扩展现实(XR)等领域。

eSP936的关键技术亮点:支持多达7个视觉传感器的数据同步处理,内置DRAM(动态随机存取存储器)芯片,并采用广角图像去扭曲技术,实现高精度环境感知与多视角3D深度地图生成。此外,其还具备高性能数据压缩能力,可降低延迟,为开发人员提供灵活且高效的平台。通过MIPI USB同步处理技术,可确保高质量2D图像和3D深度地图的输出,提升图像识别精度。

最新YX9170空间感知解决方案,适用于自动驾驶汽车

首次亮相2025年CES展,eYs3D Microelectronics还将推出其尖端空间感知解决方案YX9170。由eYs3D多传感器图像控制芯片eSP936及XINK-ll边缘空间计算平台驱动,该解决方案利用多传感器融合和AI驱动技术,在空间感知和识别领域实现重大突破。YX9170为工业、服务机器人和自动驾驶汽车研发智能系统提供了强大支持,是推动智能系统创新的关键驱动力。

YX9170解决方案的核心优势在于其全面的传感器融合能力,集成了双深度传感器,支持分辨率高达1280x720的高清图像,并可同步四台RGB摄像头,从而显著扩大感知范围,提升识别精度。通过集成多款基础立体镜头,该解决方案克服了传统立体视觉测量技术的局限。该项创新技术在多摄像头图像处理与计算架构集成方面克服了之前的挑战,成为一款基于AI的全方位空间感知系统。

YX9170解决方案的一大亮点是其智能传感功能。通过嵌入式AI算法,该系统能够从同步图像中实现实时多目标识别,使系统计算负载和延迟降低30%。通过YX9170和XINK-ll高度灵活且适应性强的软件解决方案,客户可以快速设计出集成了多传感器融合技术的定制化空间感知解决方案。

最新YX9670导航解决方案,适用于自动驾驶汽车

eYs3D还推出适用于自动驾驶汽车的YX9670导航解决方案。该创新解决方案搭载eYs3D多传感器图像控制芯片eSP936及XINK-ll边缘空间计算平台,通过先进的多传感器融合和AI驱动技术,彻底革新了环境感知和导航功能。

YX9670解决方案的核心优势在于其全面的传感器融合能力,其集成了一个支持分辨率高达1280x720高清图像的双深度传感器系统,同步四个RGB摄像头,以提供278度的全景视野。此外,该系统配备的单色摄像头可提供145度的顶部视角,内置的高效AHRS(姿态与航向参考系统)实现了船舶协同与姿态识别。此外,该系统还集成了一个热成像传感器,构建了一款高度先进的感知系统。

YX9670解决方案的嵌入式AI算法,可实现实时全景目标识别、导航方向分析及多目标跟踪。即使在复杂或恶劣的环境中,该系统还可以保持高效的探测与识别能力,展现了其卓越的技术能力。

目前,YX9670解决方案已经成功部署在自动驾驶船舶导航系统中,为物流船、环境监测船及专业无人海洋应用提供了安全且高效的导航支持。该解决方案具备尖端技术及AI计算能力,不仅满足当前的需求,还为新时代的智能导航和人机交互界面奠定了基础。

XINK-ll边缘空间计算平台(Edge Spatial Computing Platform)与Sense and React人机交互开发者工具包(Human-Machine Interaction Developer Toolkit)

在2025年CES展,eYs3D Microelectronics将首次推出XINK-ll边缘空间计算平台。该款创新平台即服务(PaaS)开发解决方案配备了eYs3D AI芯片eCV5546(集成ARM Cortex-A和Cortex-M CPU核心)和一个NPU(神经网络处理单元)。该平台支持集成AHRS,热成像及毫米波雷达传感器,同时集成了AI卷积神经网络(CNN)技术,以显著提升边缘AI设备的物体识别和探测能力。值得一提的是,ARM IoT Capital不仅为XINK-ll平台提供了资金,还显著提升了其性能。ARM CPU 配备的 Neon 指令集支持单指令多数据流(SIMD)处理,加速向量和矩阵运算,从而提升了计算机视觉和信号处理的效率。此外,低功耗的 ARM Cortex-M4 处理器作为微控制器(MCU),可实现系统控制、电机操作和时间同步。

借助下一代AI加速器的支持,该平台在性能方面超越了同类产品,提供了支持多种AI模型的可编程开发能力。面对快速发展的AI领域,XINK-ll可充分满足未来的计算需求,支持ONNX、TensorFlow、TensorFlow Lite和PyTorch等各种AI开发与加速框架,提供全面的开发工具和服务,帮助开发人员更高效的开发NPU应用。

eYs3D Microelectronics还推出Sense and React人机互动开发者界面,集成了LLM(大语言模型)和CNN传感技术。该项先进技术利用环境传感和LLM,触发动作指令与语言提示,让机器能够以对话语言形式发出指令或与用户自然交互,标志着人机交互技术进入了一个新时代。

Sense and React具备环境感知和认知、语言提示触发动作能力以及灵活适应性。通过CNN传感技术,该系统可高效感知周围环境,捕捉细微变化和动态,以实现更精准的判断和决策。此外,通过应用LLM技术,该系统基于传感器数据生成动作命令和语言提示,可提升用户便利性,并提供更为智能化的体验。

免责声明:本文为转载,非本网原创内容,不代表本网观点。其原创性以及文中陈述文字和内容未经本站证实,对本文以及其中全部或者部分内容、文字的真实性、完整性、及时性本站不作任何保证或承诺,请读者仅作参考,并请自行核实相关内容。

如有疑问请发送邮件至:goldenhorseconnect@gmail.com

- CES 2025:eYs3D Microelectronics将推多传感器控制器IC、空间感知及导航解决方案2025-01-08

- CES 2025:镜泰将推最新款车到家自动化系统HomeLink 可与苹果及安卓汽车系统兼容2025-01-08

- CES 2025丨有65万的索尼新车,也有“地表最强”智驾芯片,还有要搞火箭的丰田2025-01-08

- 【国际快讯】沃尔沃汽车2024年全球销量同比增8%;丰田汽车进军太空领域;美国调查260万辆特斯拉汽车2025-01-08

- 今年的CES,汽车领域有哪些热点?2025-01-08

- 可醇可电可油!吉利今年内将推两款全新“超醇电混”产品2025-01-08

- 宁德时代和腾讯回应被列入美国“涉军企业”名单 “是一个错误”,寻求共同解决误解2025-01-08

- 吉利控股集团2024年预计总销量约332万辆,2027年目标超500万辆2025-01-08

- 生存压力之下,日本汽车制造商将更紧密合作2025-01-08

- 恩智浦拟收购TTTech Auto2025-01-08